R&Dホットコーナー

人の行動を理解するための映像認識AIライブラリ「身体行動理解エンジン」

- リモートワールド

- 身体遠隔化

- 映像認識

NTT人間情報研究所では、あらゆる業務を必要に応じてリモートから実施可能にするために、物理的な距離の制約を超えてリアルタイムに遠隔地の状況を把握し、ロボットなどの義体を遠隔操作することを可能とする身体遠隔化技術の確立をめざしています。義体の遠隔操作では、リアルタイムに遠隔地の状況を分析し、義体の動作や義体周辺の人や環境の情報を操作者へ適切にフィードバックする必要があります。そこで、遠隔地にいる人がどのような行動をしているのかを把握するため、人の行動をカメラ映像から自動で認識するための身体行動理解エンジンを開発しましたので紹介します。遠隔操作者へのフィードバックをリアルタイムで行うためには、認識処理のリアルタイム化が重要となります。本エンジンでは認識処理を軽量化する技術を開発し、CPUでリアルタイムに複数人の行動を認識することを実現しました。

高木 基宏(たかぎ もとひろ)

NTT人間情報研究所

身体遠隔化技術

2020年の新型コロナウイルス感染症の影響をきっかけに、地理的、時間的な制約を超えて、さまざまな業務のリモートワーク化を実現する技術が求められています。特に建設業務、介護・看護業務などのエッセンシャルワークは、身体的な動作を必要とする現地での業務が多く、リモートワークが困難な状況です。エッセンシャルワークなどの身体的な動作を必要とする業務をリモートワークで実現する1つの方法として、遠隔地にあるロボットなどの義体を遠隔から操作して業務を実施する方法が考えられます。義体を操作するリモートワークでは、操作者がリアルタイムに遠隔地の義体および義体周辺の状況を把握し、違和感なく操作する必要があります。そこで、NTT人間情報研究所では、遠隔地の状況をリアルタイムに把握し、ロボットなどの義体を違和感なく、高効率に遠隔操作することを可能とする身体遠隔化技術の確立をめざしています(1)。身体遠隔化技術を実現するためには、遠隔操作者が遠隔地の状況を把握するため、ロボット搭載カメラや監視カメラなどのセンサから得られる映像データを基に遠隔地の人の行動や周辺環境を低コストに把握、理解する認識技術が必要となります。私たちは、遠隔地の人の行動や周辺環境を把握するため、カメラ映像を用いて、人の行動を認識する身体行動理解エンジンを開発しましたので紹介します。本エンジンは認識処理を軽量化し、CPUでリアルタイムに複数人の行動を認識することを可能としました。また、導入にあたり障壁となる学習データ構築コストやマシン環境構築コストの削減を可能としました。

低コスト導入を実現する身体行動理解エンジン

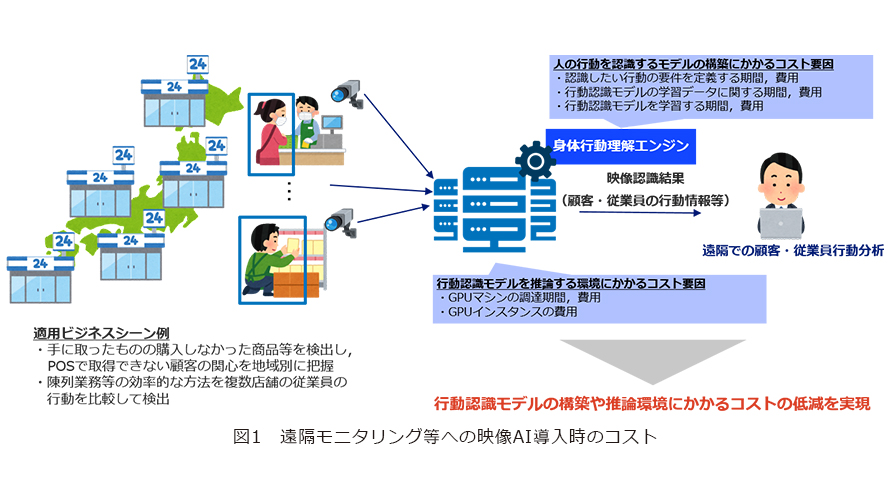

近年、デジタルトランスフォーメーション(DX)分野、特に店舗や工場などで取得された映像から人(顧客・従業員等)の行動を自動分析する技術に多くの関心が寄せられています(図1)。例えば、映像中の人の行動を認識することにより、店舗で手に取ったものの購入しなかった商品等を映像から検出することができます。これにより、POS(Point of Sale:販売時点情報管理)では取得できない顧客の関心を、映像から遠隔でモニタリングできるとともに、地域別に集計することでニーズの分析ができるようになります。また、従業員の行動で非効率な動きを検出し、複数店舗の従業員の行動を比較することで、例えば陳列業務などの効率的な行動を分析することができます。このような分析で、顧客の満足度や従業員の生産性の向上が期待されています。

しかし、人の行動を認識するモデル(行動認識モデル)の構築に必要な、学習データ準備に要するコストが高く、行動認識モデル導入の障壁となっています。具体的には、大量の映像取得、目視確認による認識したい行動の抽出、さらに大量の映像への行動ラベルアノテーションといった作業が必要となります。加えて、認識処理を行うためにはGPU(Graphics Processing Unit)マシン等の利用が前提となっていることが多く、マシン環境の構築コストが導入を阻害する要因となっています。

そこで、NTT人間情報研究所では、学習済みの行動認識モデルをプリセットすることにより、学習データ構築に必要な期間を短縮、費用を削減し、さらにGPUのみならずCPUでも動作可能とすることでマシン環境構築コストの削減を可能とする身体行動理解エンジンを開発しました。

ポイントとしては、以下2点が挙げられます。

・ポイント①:学習済み基本行動認識モデルをプリセットすることにより、追加学習不要で行動の認識・検索を可能にしました。

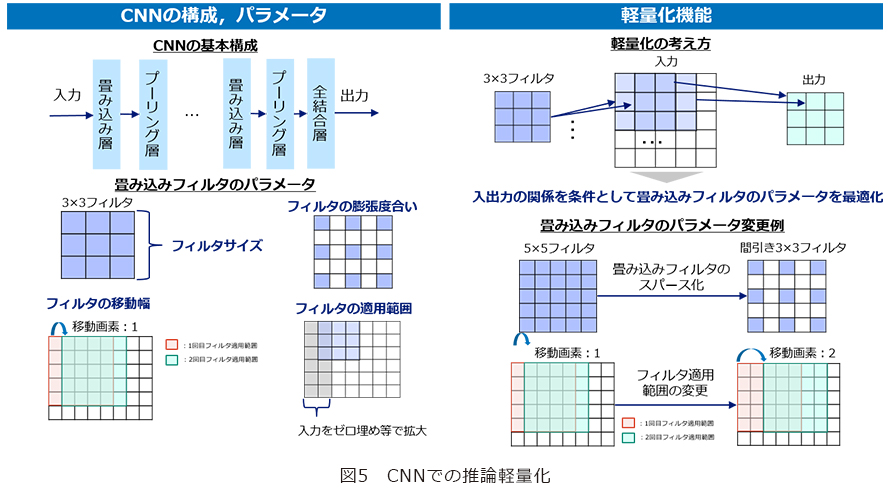

・ポイント②:基本行動認識モデルにおける畳み込みニューラルネットワーク(CNN: Convolutional Neural Network)の認識処理を軽量化することによりCPUマシン等の低廉なマシン環境で動作を可能にしました。

2つのポイントについて説明します。

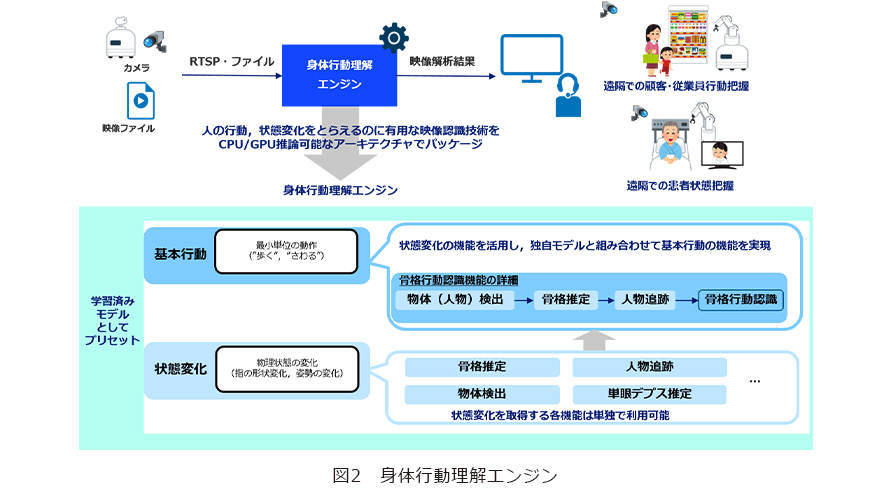

(1) 基本行動認識・行動検索機能

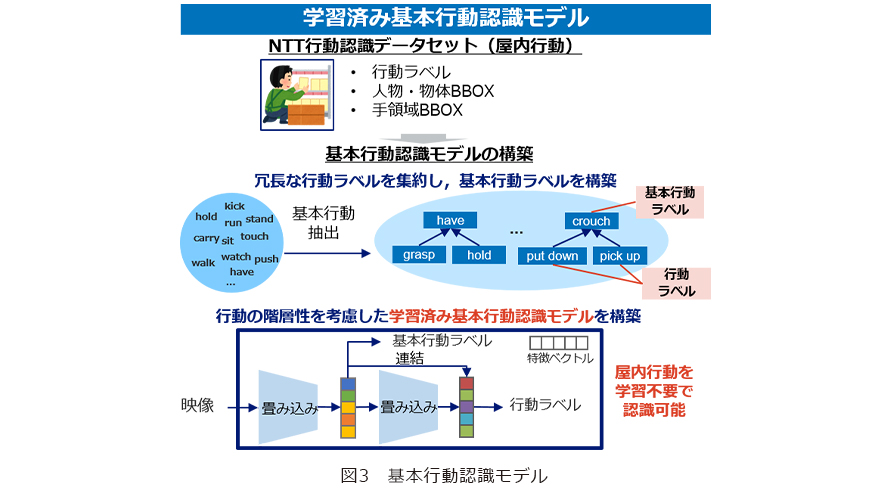

NTT人間情報研究研で開発した身体行動理解エンジンは、行動の階層性を考慮してさまざまな業界で共通する汎用性の高い基本行動ラベルを定義し認識することで、人の行動を頑健に認識するNTT独自の行動認識モデルを搭載しています。具体的な処理として、最初に姿勢の変化などの状態変化の認識処理を行い、次に状態変化の認識結果を用いて基本行動を認識します(図2)。基本行動認識の際には(図3)、汎用性の高い基本行動ラベルを行動の階層性を考慮して定義し、定義された基本行動が認識できるよう学習した基本行動認識モデルをあらかじめ身体行動理解エンジンにプリセットしています。

プリセットした基本行動の学習モデルは、比較的照明条件の整った屋内の実環境(コンビニ映像等)を対象とした学習データを用いて構築しています。この学習済み基本行動認識モデルを用いることで照明条件の整った屋内を対象に頑健な基本行動認識が可能です。学習データセットと類似する屋内の環境下であれば、プリセットされた学習済みの基本行動認識モデルをそのまま利用できるため、行動認識モデル構築の期間の短縮、費用の削減が可能です。

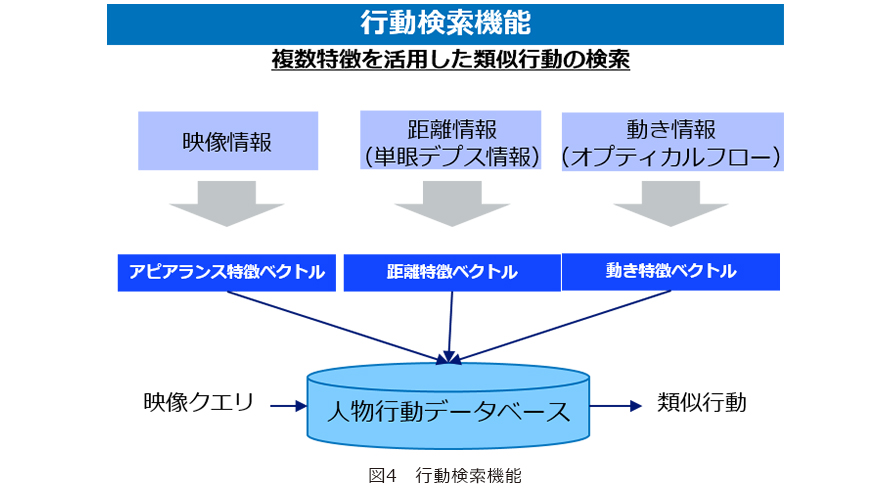

また、蓄積された大量の映像に対し、目視観察で映像中の重要行動などを指定し、その重要行動と類似する行動を大量の映像から検索して収集することも可能です(図4)。カメラの映像から取得できる映像情報、距離情報、動き情報から複数の特徴を構成し、その複数特徴の組合せを利用して重要行動と類似する行動が起こりやすい場所・時間の特定を可能としました。

(2) CNNモデル軽量化機能

映像における身体行動認識の処理の一部は、CNNを用いて行います。CNNでは畳み込み演算を繰り返し適用しますが、この演算処理が計算量を増大させている要因の1つとなっています。本技術では、この畳み込み演算に用いる畳み込みフィルタのパラメータを最適化することで、精度を保ちつつ軽量化を実現しました(図5)。具体的には、人間の視覚受容野の特性を利用した畳み込みフィルタの入出力の関係を条件としてスパース化や適用範囲を変更することで精度低下を抑えて計算量を削減しています。計算量の最適化により時間的な次元も考慮した処理も軽量化でき、GPU非搭載のマシンでもリアルタイムに複数人の行動認識が可能となりました。

まとめと今後の展開

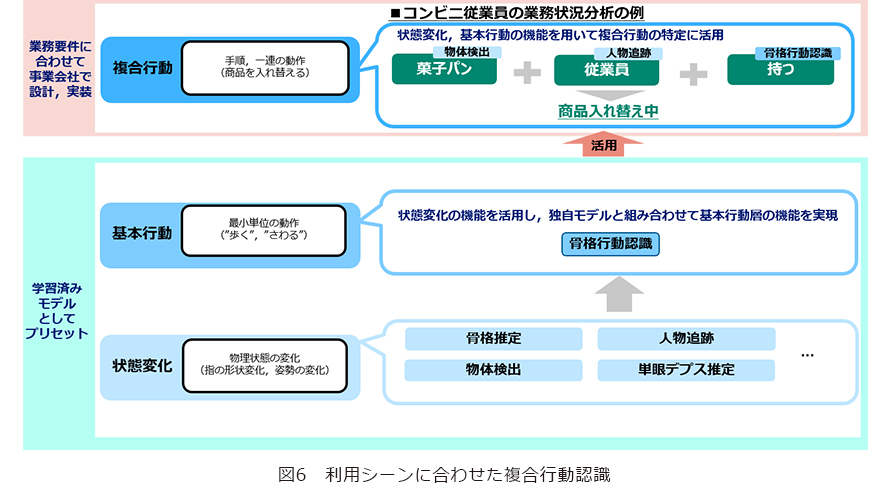

学習済み基本行動認識モデルをエンジンに搭載し、さらにCNNの認識処理を軽量化することにより、学習データおよびマシン環境の構築コスト削減を実現しました。本エンジンにより、屋内での基本行動認識において、導入時の学習用映像データ収集やラベル付与、行動認識モデルの学習を不要とし、かつCPUマシンで複数人の基本行動をリアルタイムに認識することができます。今後は身体行動理解エンジンが認識した基本行動や物体とのインタラクション情報を組み合わせることで、業務の分析に役立つ複合行動の認識を実現していきます。「店舗内で商品を陳列している」等、業務マニュアルに記載がある複合行動の認識を可能とすることで、身体行動理解技術の業務分析への利用が容易にできるよう研究開発を進めていきます。(図6)。

問い合わせ先

NTT人間情報研究所

サイバネティックス研究プロジェクト

E-mail cyberne-hosa@ntt.com

NTT人間情報研究所では、エッセンシャルワークのようなリモートワークが普及していない業務においてもリモートワークができる環境の実現に取り組んでいきます。