2026年5月号

挑戦する研究者たち

人間の感覚情報から運動生成までのメカニズム解明と視覚障害者の行動を支えるデバイス開発に挑む

人間が視覚などの感覚情報を起点に身体運動を生成させるまでの流れで、一体、脳はどういった情報処理をしているのでしょうか。NTTコミュニケーション科学基礎研究所の五味裕章客員上席特別研究員は、計算モデルによるシミュレーションや動物の脳波を解析することにより、その基礎的なメカニズムの解明に取り組んでいます。一方で、視覚障がい者が街中でも安心して行動できる、力覚デバイスを使ったシステムの研究開発にも力を注いでいます。今回のインタビューでは最近の研究成果や今後の展望、そして現在大学教授も兼任されている立場から日頃感じていることを伺いました。

五味裕章

客員上席特別研究員

NTTコミュニケーション科学基礎研究所

感覚情報とはどのように形成されているのだろうか

最近の視覚情報から運動生成までの情報処理に関する研究について教えてください。

私は感覚情報から運動生成までの情報処理について解明・モデル化する研究を一貫して行っています。前回のNTT技術ジャーナルのインタビューでは視覚情報が入力されてから運動が起こるまでの過程で、私たちが発見した潜在的なプロセスの特性について紹介しました。ところで感覚情報といっても、視覚、聴覚、触覚、体性感覚などさまざまな種類の情報があります。これまでの多くの研究で、それぞれの感覚情報がどのように処理されているか、ということが調べられてきたのですが、「そもそも感覚の情報処理はどのように形成されるのか」、という根本的な問題を考えることも重要であると私は考えています。生物が進化していく過程で、さまざまな感覚器官が備わってくるわけですが、進化のような長い年月を経なくても、生物は生まれた後にも、感覚器官やその情報処理が変化していきます。感覚情報処理の形成は外の環境や自身の身体状態を知り、その環境とインタラクションしていくうえで非常に重要です。人も動物も成長するに従い、身体の大きさは変化し、環境との関係性も変化していきます。これらのことを考えると、感覚から入ってくる情報の処理も適応や学習によって変化していくことが必要なのではないか、という発想が湧いてきます。

過去の研究では、この考え方を支持するものばかりでなく、感覚情報処理の形成や調整の要因として、入力の統計的性質に重きを置くものもあります。今述べたような思索や過去研究に基づいて、運動を中心に研究してきた私は、感覚情報処理は運動を適切に行うように形成や調整がされているのではないか、という考えでどの程度のことまで説明可能かを考えてきました。私たちはこの仮説を検討するために、感覚運動制御のメカニズムを解析的・構成的に解明する研究を進めるとともに、将来的に「学習する人間のようなしなやかな機能を持つ機械(ロボット)」の情報処理の構築に活かせる可能性についても探っています。

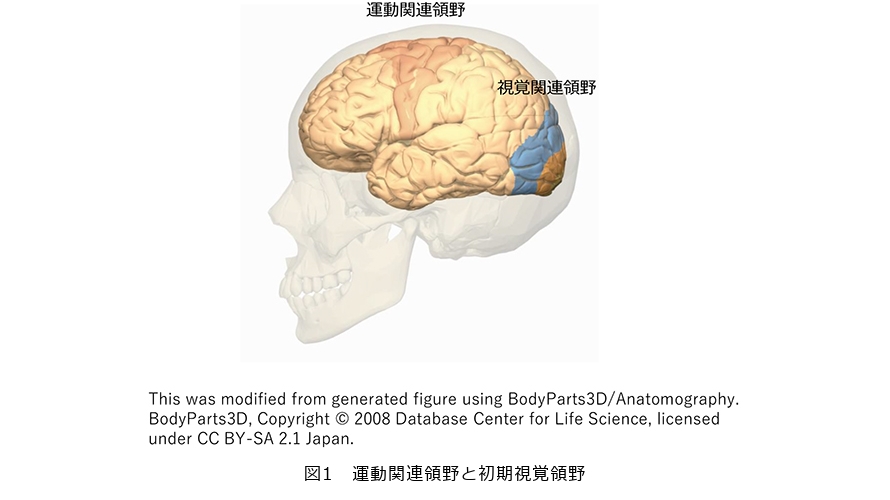

ここで、運動生成や視覚分析の情報処理が、脳のどこで行われているかについて簡単に説明させてください。脳には「運動野」と呼ばれる、筋骨格系に直接指令を送る細胞群がある領域の周辺に、運動生成に関連する領野がいくつかあります。こうした運動に関連する脳領野が活動し、脊髄を経由して筋骨格系に対して指令が送られることで、実際の身体の多くの運動が生成されます。それに対して、運動をするための外界情報を得る「視覚」については別の領域で情報処理が行われています。目から入った情報は大脳の視覚野へと送られ、視覚関連領野において視覚情報の分析が行われます。視覚情報がどのように分析されるのかという問題は、長年の数多くの優れた研究によって、領野ごとの処理の内容が明らかになってきています。図を見てお分かりのように初期の視覚分析を行う1次視覚野と呼ばれる脳領域は、運動関連領野からは大きく離れています(図1)。その間には、高次視覚情報処理や外界空間表現を計算する領野など多くの領野が存在し、初期的な視覚情報の分析と運動生成の情報処理の間には、多段の神経処理が行われます。そのため、これまでは視覚情報処理と運動生成情報処理は、専門の異なる別の研究者によって調べられることが多くありました。事実、私たちも運動生成の情報処理を中心に研究してきました。

さてここで少し古い研究を2つご紹介したいと思います。1つは子猫の行動に関する大変興味深い実験です(1)。能動的な子猫は装置内を自由に歩くことができ、自分の動きに合わせて周囲の視覚情報が変化します。一方の受動的な子猫は箱に乗せられ、能動的な子猫の動きに合わせて「運ばれる」だけです。視覚刺激は能動的な子猫と全く同じものを受けますが、自分自身の足の動きとは連動していません。この実験後、能動的な子猫はその後も視覚的に正常な動きができたのに対し、箱の中に入れた受動的な子猫はそれができませんでした。つまり、正常な視覚情報処理(視覚の発達)には単なる「見る」経験だけでなく、「自分の意志で運動し、それにより視覚入力が変化する」というアクティブな視覚経験が必要であることが示唆されました。

もう1つは雑誌『Nature』にも掲載された有名な研究(2)です。ストライプ柄(縦縞模様)の箱の中で、視覚の発達に重要な臨界期以前から猫を飼育し生育させていくという実験です。このように育った猫は視覚野の多くの細胞が縦縞に反応するようになることが発見されています。この話はその後もさまざまな検証研究が行われ、視覚野細胞における反応特性の形成メカニズムがより詳細に明らかになってきていますが、これら先人の研究結果から、自主的に運動をすることは、運動脳を鍛えるだけではなく、視覚など感覚の情報処理も同時に鍛えているということを示唆しています。

視覚情報処理の研究者からは、視覚の情報処理は視覚だけの経験で発達するのではないかといった意見もありますし、一部にはその要因で説明されることもあると思います。しかしながら、先に申し上げた研究や、他の感覚運動系の研究も併せて考えると、「運動あるいは運動に必要な情報処理のために感覚情報処理が獲得されたり調整されたりする」、という考えで、どこまで感覚情報処理が説明可能かを突き詰めて検討したいと私は考えています。

前回のインタビュー(3)では、視野に動きを与えると手が動かされるという反射的、潜在的な情報処理があること、そしてその特性から自己運動由来の情報処理が重要であることが示唆されたという話をさせていただきましたが、そこで用いた構成的解析という手法をこれから紹介する研究でも使っています。まず、さまざまな場面において自分で動いているときの視覚情報、すなわち一人称画像を映像で記録し、そのデータをAI(人工知能)で広く用いられているコンボリューショナル・ニューラルネットワーク(CNN)へ入力し、その映像に対応する自分の頭部の動き、すなわち自己運動を出力とするように深層学習させます。CNNは現在のAIの発展をもたらした技術の1つですが、この原型は福島邦彦先生が視覚野細胞の特性や階層構造にヒントを得て提唱されたものです。さてこのような学習を行うと、CNN内で形成される視覚解析特性が、手の潜在的な応答特性とよく類似することが分かりました。この点については前回詳しくお話ししました。

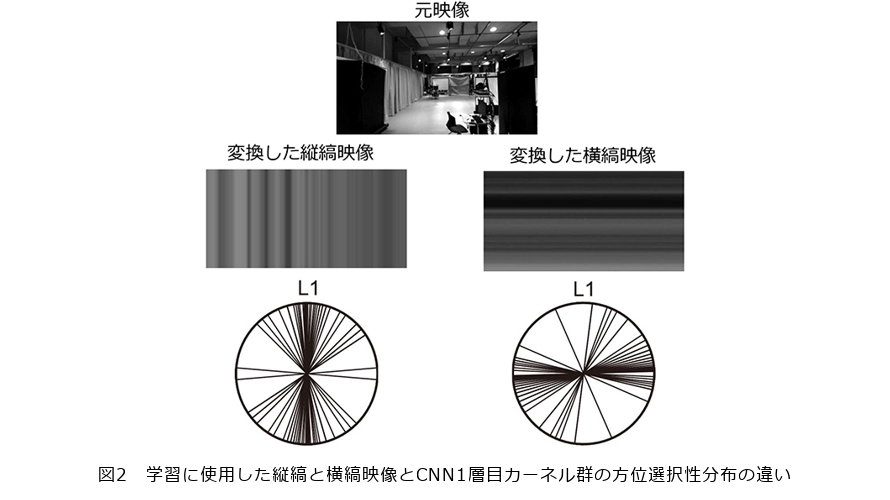

今回はその話の延長で、先ほど紹介した猫の実験にヒントを得て行った計算機実験について説明します。まず、元の自己運動をしている最中の一人称映像に、変換を施して縦あるいは横のストライプのみが見えるようにした映像を作成します。その映像を用いてCNNを学習させ、どのような特性がCNN内部で獲得されるのかを調べました。すなわち、猫を縞模様の環境中で育てる実験は、視覚から運動情報への変換を獲得するプロセスとみなし模擬したことに相当します。その結果、縦縞で映像を学習した場合にはCNN低次層で縦縞に反応するカーネルが多く形成され、横縞で学習した場合には横縞に反応するカーネルが多く形成されるような分布が得られました(図2)。すなわち、映像を入力として、身体運動をするための重要な状態量である「自分の動き」の推定をできるように学習させるだけで、環境の視覚情報に依存した生後の臨界期において見られる特異的な視覚野ニューロンの特性形成が、モデル上で模擬できたわけです。この特性は、必ずしも自己運動学習のみで起こるわけではないと思いますが、身体運動を表現することが視覚解析の基本的な機能の形成に役に立っている可能性を示唆しています。

脳全体の活動を見える化

運動が起こる際の脳全体の活動を理解する研究もされているそうですね。

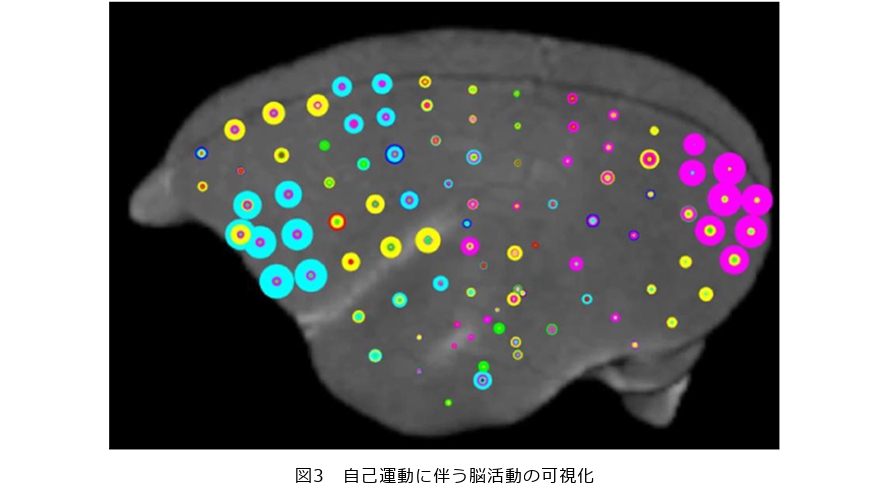

もう1つ、最近取り組んでいる研究を紹介します。沖縄科学技術大学院大学(OIST)との共同研究で進めている、マーモセット*という小型サルの自由運動中における脳活動の分析です(図3)。脳活動データは、理化学研究所で記録されたもので、脳皮質の広い領域の上に配置された多数の電極から脳活動が記録されています。この計測ではサルが日常的に活動している状態で行うことができるため、非常に多くの情報を含んだデータが得られます。私たちは、そのデータの一部を提供していただき、頭部運動が起こる際に脳の部位ごとにどのような変化が現れるのかを「見える化」することにより、脳皮質での情報の流れや処理を理解することを目的に研究を進めています。

このように脳活動が見える化された動画を見ていると、頭を動かす少し前から脳の一部が活動し始めるのが分かります。まず運動関連領野が活動し、そこから前頭葉、そして頭を動かし始めると同時に視覚野、そして頭頂連合野と側頭野のほうへと活動領域が動いていく様子がみてとれるようになりました。個々の脳領域の活動は今までにもよく調べられていますが、自由行動下での感覚運動に関係する脳活動を調べることはなかなか難しいことでした。私たちもまだ始めたばかりですが、OISTや理研と連携させていただくことで、自由行動下で環境とインタラクションしながら連続的に行われる意識的・無意識的な感覚運動情報処理の理解を進めていきたいと考えています。

* マーモセット:ブラジルなどの熱帯雨林に生息する、体重200〜500g程度の小型の真猿類(新世界ザル)。ヒトと脳機能などが似ており、医学・神経科学研究のモデル動物として広く利用されています。

視覚運動系の情報処理に関する基礎研究について今後の展望をお聞かせください。

これまで私たちは、特に潜在的な視覚から運動生成に関する情報処理について研究を深めてきました。前述したマーモセットの研究で、潜在的な脳の情報処理がどのように組み立てられているのか、との問いに対して、新たな攻め方や重要な手掛かりもみえてきています。脳の情報処理を一定程度理解できれば、それを構成的にモデル化してロボット運動系に活かせるのではないかと考えています。現在、私は早稲田大学の教授も兼務しており、ロボットの研究をされている先生方も多くいらっしゃいますので、連携して脳の情報処理をロボットへ組み込んでいく研究も進めたいと考えています。

最近では米国や中国が非常に高性能なパフォーマンスを見せるロボットを発表し、メディアを賑わせていますが、人間の動きを研究してきた私には、動きが不自然に感じられてしまいます。やはり人間の動きと比較すると、なんともぎこちなく明らかに人とは異なります。それは、いまだに人間の持っている潜在的な情報処理の理解が十分でなく、ロボットに実装できていない、つまり外界環境と相互作用しながら学習していくメカニズムが組み込まれていないからだと思うのです。是非このような課題をクリアし、AIロボティクスでの新たな領域を開拓できるよう、研究を進めていきたいと思います。

力覚と映像とのコラボレーションで視覚障がい者の行動を支援

最近の「ぶるなび」の進展状況についてお聞かせください。

一昨年「サイトワールド」という視覚障がい者が使用する機器の展示会で、NTTドコモと連携して「ぶるなび」のデモ展示をさせていただきました。この機器を初めて触る視覚障がい者もたくさんいらっしゃいましたが、引っ張られる感覚をすぐに理解してもらえて、大変好評でした。少し前のデータですが、WHOによると視覚障がい者は弱視を含めて世界に2億8500万人も存在し、その数は今後も増えていくだろうと予測されています。高齢になっていくと白内障や緑内障の症状が出やすく、視野欠損してしまうことも多くあります。視覚障がい者は、現在白杖を使って周りを探索し歩行されています。しかし、点字ブロックなどがあるとはいえ、その整備は必ずしも十分ではなく、いまだ道路の歩行には困難が伴います。

視覚障がい者がICT機器を活用して、点字ブロックの有無にかかわらず気軽に出かけやすくすることはできないものだろうかと研究に取り組んでいます。昨年は、「ぶるなび」を一層進化させていくべく、株式会社コンピュータサイエンス研究所とのコラボを行いました。彼らも私たちと同様の視覚障がい者への思いのもと、「アイナビ」というサービスを開発しています。

「アイナビ」は、スマートフォンで得られる画像を、AIがリアルタイムで分析し、障害物の有無や交通信号の色、方向・ルートなどの情報を音声でフィードバックするシステムです。しかし、音声を生活の中で活用することは難しい局面もあります。まず、空間情報を言葉で伝えるのが難しい場合があります。例えば、「次の交差点で右から2番目の道を20メートル直進」と言われたところで、視覚情報がなければ、「次の交差点」も「右から2番目の道」も分かりません。そして、特に屋外では騒音により音声がかき消されてしまうケースも多々あるでしょう。また、周囲の音は環境の状態を知るうえでは重要で、ガイド音声だけに集中してしまうと危険なこともあります。

今回、全盲の方にご協力いただき、実際の環境で歩行している様子を撮影させていただきました。点字ブロックがはがれていたり、音の出ない信号があったり、曲がる場所を間違えて通り過ぎてしまったり、さまざまな障害物があるなど、視覚障がい者には多くの困難が日常生活で存在していることがよく分かりました。

やはり視覚障がい者にとっては「こっちだよ」と手を引いてくれる手段があると非常に有効です。これらの点も踏まえ、視覚障がい者の方がより便利に1人で自由に街を歩けるようにならないかと、まずはコラボレーションして「ぶるなび」と「アイナビ」とを合体するシステムを組んでみましょうということになりました。

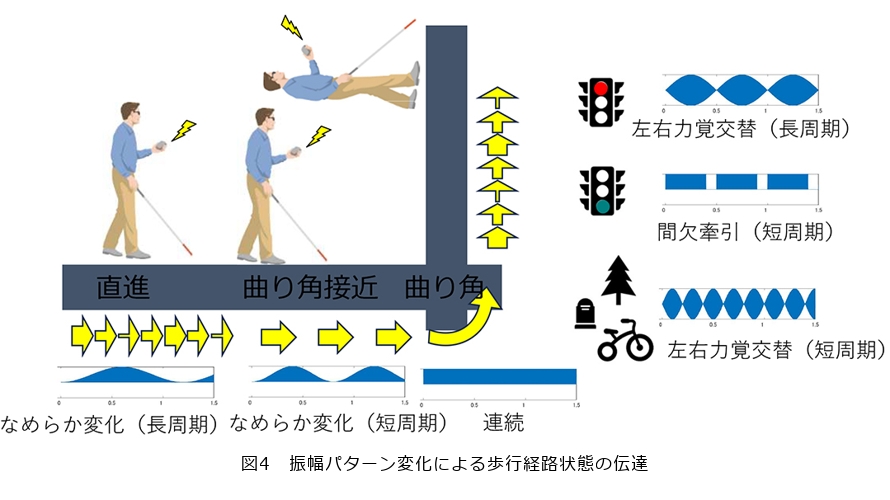

そして、2025年のNTTコミュニケーション科学基礎研究所のオープンハウスにてデモンストレーションを実施しました。この両社のコラボで生まれた新たなシステムでは、これまでの「方向」を伝えることに加え、振動にさまざまなパターンの色付けを行い、言葉がなかったとしても、「青信号で横断歩道を渡っている状況なのか」「しばらく直線的に歩くのか」「次の曲り角に近づいたのかどうか」など現在の状況を振動パターンでユーザへ伝わるような工夫をしました(図4)。屋内でのデモでしたので、実際の歩行誘導は体験いただけませんでしたが、歩行中に撮影した一人称映像を大型モニタに投影し、それを実際にスマホカメラで認識させて、ぶるなび でパターンの異なる牽引感覚を感じていただくまでの流れをお見せすることができました。これらの実装をしながら、人間の知覚や認知の新たな側面を調べる課題も見えてきて、大変有意義なコラボでした。

「ぶるなび」の開発について今後の展開をお聞かせください。

NTTの中でこの研究を事業展開できないかと何度も検討していただいたのですが、視覚障がい者の歩行誘導だけを対象として考えると、周辺技術がまだ不十分なこともあり、いまだに実現していません。しかしここで諦めるのではなく、より良い力覚デバイスを考案したり、その成果を社会実装していく研究は学生と一緒に続けていきたいと考えています。また、他企業とのコラボレーションやベンチャー化は、もしかすると、大学のほうが小回りもきいてよいのかもしれません。実際、大学では研究成果のベンチャー化の営みが多く行われており、せっかく面白い装置も考案できたので、社会に役に立つかどうかの問いかけも続けていけたらと考えています。現在、世の中には「ぶるなび」以外に複数の歩行誘導技術が開発されていますが、その開発者や研究者と情報交換しつつ、視覚障がい者の好みに応じて、それぞれを選択していただければ良いのではないかと思っています。

また、視覚障がい者だけでなく、私たちも日常生活を送る中で、特に広いビル内や地下道では道に迷うことがあります。そのようなときに、このようなデバイスがあれば役立つことが大いにあるだろうと思いますので、多くの方に使っていただけるような技術に発展させていけたらと思います。

大学では発想豊かな学生たちとワクワクする研究をしていきたい

現在、大学主体で研究をされていますが、企業に所属していたときと比較して環境に変化はありましたか。

私は現在、NTTで客員上席特別研究員をさせていただきながら大学を主軸に活動しています。大学は企業と異なり研究資金は自身で獲得していかなければなりませんが、テーマの縛りはなく、自身の発想でさまざまな研究ができるという自由度があるように感じています。1つの企業の中ではもちろんその組織の目標や価値観が全面的に出てくるものですが、大学では多様な価値観を持った人材で構成され、多様なエキスパートもいます。またさまざまな企業と結びつくこともできます。そして、一番違うと感じたのは学生の存在です。これから私の研究室にも学生が参入してきますが、すでにいくつかの講義や面談をとおして学生たちと触れ合っています。その学生たちを見ると、皆目が輝いており、学びたいという意欲や好奇心にあふれていています。彼らは発想も豊かで、時には突拍子もないようなことを言うときもありますが、そういった色のついていない自由な発想は大切ですし、そんな彼らと日々接することができるのは、自分の発想を豊かにすることや基本問題に立ち返るためにもとても良いと思います。前回の取材でお話ししたかもしれませんが、学生や研究者の皆さんには少しでも楽しんで、興味を持って勉強や研究に取り組んでもらいたいと思いますし、私自身も「研究の面白さを伝えられる人」になりたいと思っています。

大学の所属学科には、新材料・エンジン・熱・流体・マイクロデバイスなどさまざまな分野の専門家がおられますが、それぞれの面白さを伝えるのも大変上手なのです。今流行りのAIなどと比較して材料の分野などは多少地味に見えてしまうかもしれませんが、実はその分野の最先端技術の話をお聞きすると、とても知的好奇心をそそられます。自分もこういったワクワク感を伝えていけたらなと思っています。やはり楽しいからこそ困難に立ち向かえる、楽しければハードルの高い仕事も続けられるのです。

■参考文献

(1) R. Held and A. Hein: “Movement-produced stimulation in the development of visually guided behavior,” J. Comp. Physiol. Psychol., Vol.56, No.5, pp.872-876, 1963.

(2) C. Blakemore and G. Cooper: “Development of the Brain depends on the Visual Environment,” Nature, Vol.228, pp.477-478, 1970.

(3) https://journal.ntt.co.jp/wp-content/uploads/2023/10/nttjnl1101_20231101.pdf