2024年2月号

特集1

Project Metaverse――リアルとサイバーの融合によるWell-beingな社会の実現

- メタバース

- Another Me

- XR

NTT人間情報研究所(人間研)では、超高速・超低遅延・超低消費電力の次世代コミュニケーション基盤「IOWN(Innovative Optical and Wireless Network)」により実現される、リアル世界とサイバー世界が融合する「IOWN時代のメタバース」に関する研究開発を推進しています。本稿では、その構成要素である「空間」と「ヒト(アバター)」に分けて、人間研の最新の取り組みについて紹介します。

阿部 直人(あべ なおと)/千明 裕(ちぎら ひろし)

小合 健太(おごう けんた)/望月 崇由(もちづき たかよし)

石井 陽子(いしい ようこ)/永徳 真一郎(えいとく しんいちろう)

Lidwina Andarini

鈴木 克洋(すずき かつひろ)/野本 済央(のもと なりちか)

深山 篤(ふかやま あつし)

NTT人間情報研究所

背景

本稿のタイトルにもある「Metaverse(メタバース)」という言葉は、もともと1992年に発表されたSF小説『スノウ・クラッシュ』に登場する、仮想空間を介した架空のコミュニケーションサービスの名称でした。その後、技術の進展によってさまざまな仮想空間サービスが登場するに伴い一般名詞化して、人々が自身の分身である「アバター」を介して他者と交流する、インターネット上の仮想空間サービス全般を指す言葉になりました。

古くは1990年に開設された「富士通Habitat」(富士通)のように、2Dの仮想空間上のアバターを介して交流するチャットサービスに始まり、「Second Life」(Linden Lab)のように、仮想空間内の通貨により、土地やアイテムの売買等、現実に近い経済活動までカバーしたサービス、さらに最近では「Fortnite」(Epic Games)や「あつまれ どうぶつの森」(任天堂)のような多人数参加型の仮想空間オンラインゲームや、ビジネス向けの「Horizon Workrooms」(Meta Platforms)や「Mesh for Microsoft Teams」(Microsoft)に至るまで、「メタバース」的仮想空間サービスは多岐にわたっています。

このように、「メタバース」の概念や「メタバース的」サービスは、以前から存在していましたが、その統一的な定義はまだありません。現在、大手テック企業のトップや有識者からいくつかの定義や見解が示されていますが、「メタバース」の核となる性質・備えるべき特徴として、米国の投資家Matthew Ball氏が2020年に整理・発表したものが、1つの指針となっています(1)(表)。

これらの性質・特徴をすべて備えた、広大なメタバースが登場するには、「数10年にわたるインフラ整備と数10億ドルの投資が必要」との指摘もありますが、一方で①メタバースの中核技術である、VR(Virtual Reality)やAR(Augmented Reality)等、XR(Cross Reality)関連技術の進化・低廉化や、②近年のコロナ禍において、豊かなコミュニケーションや多様な体験を実現できる、現実により近づけた仮想空間に対する期待の高まりもあり、メタバースの社会実装が進んでいます。

Project Metaverse

NTT人間情報研究所(人間研)では、すべての人がWell-beingな状態になれる社会をめざして、“真のヒューマニティを育むテクノロジの研究開発”をミッションに、“人間中心を原則に、あらゆるヒトの機能を情報通信処理可能にする”ことをビジョンに掲げています。このビジョンの実現に向けた取り組みの1つが「Project Metaverse」です。

前項でも触れたとおり、これまでのメタバースでは、その大半がリアル世界とは別の体験を提供することを主な目的としていました。そのためメタバース上での体験を、リアル世界で直接的に活用することは困難でした。また、さまざまなメタバースがサービス提供されてきている一方で、身体的制約から1人のユーザが利用できるメタバースは限られており、多様な体験を享受することは困難な状況です。

そこで私たちは、①超リアルな仮想空間およびサイバー・リアルの交錯空間と、②本人性・自律性を有するアバターを実現することで、複数のメタバース上で、リアル世界と同等かつ多種多様な体験をユーザに提供したいと考えています。こうすることで、時空間や身体の制約はもちろん、サイバー・リアルの垣根も越えて、ユーザ体験の活用・共有が促進されるとともに、他者の価値観に触れる機会が増え、個々人はもちろん社会全体のWell-beingが実現できると考えています。

本稿では、大きく2つの側面に分けて、「Project Metaverse」の具体的な取り組み・関連技術について紹介します。

・サイバー世界とリアル世界をシームレスにつなぐ「空間表現・空間融合」

・サイバー世界上で、多種多様な体験を可能にする「Another Me」

空間表現・空間融合

■空間表現:五感で感じる仮想空間の構築

現実の建造物・史跡・景観を、リアルなメタバースとして仮想空間に再現し体験可能にする取り組みは、主に地方創生や地域活性化を目的とした観光分野を中心に、研究レベルから商用サービスまでさまざまな方法が試みられています。しかし、楽しさ・没頭状態を阻害する共通の課題として、リアル世界の体験とサイバー世界の体験では臨場感に乖離があることが挙げられています。特に広い範囲を移動しながら風景・自然を楽しむような体験では、視覚的に精緻かつ広範囲な空間再現に高いコストが必要であることや、実際にその場を訪れた際の体験・体感を、そもそも視覚情報だけで再現することが難しいことなどから、高い臨場感を提供することは困難でした。

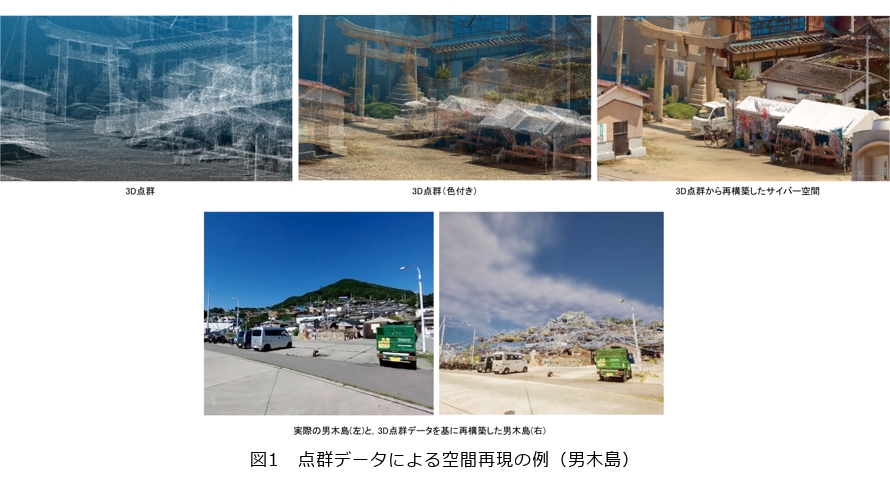

そこで私たちは、瀬戸内海の中央にある小さな離島「男木島」を対象に、五感で感じる仮想空間の構築に取り組みました(2)。具体的には、特に一般ユーザ向けのメタバースではほとんど利用されることのない①自動運転などにも使われている、実際の空間を広範囲かつ簡易に計測・把握することが可能なLiDAR(Light Detection and Ranging)と呼ばれるセンサ技術から得られる「点群データ」とこれを解析・統合する「3D点群メディア処理技術」、②さまざまなアングルから撮影した複数の写真からリアルな3DCGを生成するフォトグラメトリ技術を採用することで、できるだけコストを抑えつつ、視覚的に精緻かつ広範囲な仮想空間を構築しました(図1)。またこれと併せて、③視覚以外の聴覚や触覚を刺激する「その場」に存在する感覚情報を、立体音響技術や新たに開発した音声・振動による歩行感提示手法(図2)により忠実に再現・統合することで、五感を介してあたかもその場にいるような感覚をユーザに提供可能にしました。これにより仮想空間上での体験がリアル世界のものと同等になることで、その体験をリアル世界にシームレスに活用できるようになると私たちは考えています。

■空間融合:2つの世界にまたがる交錯空間の構築

通常、メタバース上で活動するユーザの分身である「アバター」は、仮想空間内に閉じた存在であり、コミュニケーションの範囲も仮想空間内に限定されています。そのため、リアル世界のユーザからはその様子は確認できず、その結果「エコーチェンバー」や「フィルターバブル」と呼ばれる現象を引き起こし、サイバー世界とリアル世界の分断・対立が生じることにもなりかねません。

そこで私たちは、サイバー世界上で活動するユーザ(アバター)と、リアル世界上に存在するユーザが、両世界の垣根を越えてコミュニケーション可能にするための研究にも取り組んでいます。その1つが、サイバー世界上の情報(コンテンツやアバター)とリアル世界を位置的に対応付ける「高精度VPS」、もう1つがVRゴーグル等特殊な装置を装着せずにサイバー世界上のアバターやバーチャルキャラクターとのコミュケーションを可能にする「裸眼XR相席対話システム」です。

前者は昨今のARサービスでも活用されている技術になりますが、前述した「点群データ」により精緻かつ広範に再現された仮想空間と、カメラを具備するスマートフォンやARグラスを組み合わせて利用することで、これまでよりも低コストかつ精緻に、サイバー世界とリアル世界のユーザをお互いの空間上に正しく位置付け、同一空間上での自由なコミュニケーションが可能になります(図3)。また後者では、ハーフミラーと、ディスプレイや机、ソファー等実物体群の多層的な3D配置設計により、リアル世界のユーザとサイバー世界のアバター等がすぐ隣に並んで相席できる交錯空間を表現可能としています。これによりユーザがVRゴーグル等を装着せずに、両世界に存在する複数のユーザ間で自然な双方向コミュニケーションが可能になります。

なお後者の「裸眼XR相席対話システム」は、2023年4月の「超歌舞伎powered by NTT」の会場で、初音ミクと同一の空間での相席対話が楽しめる、「あいせき幻燈茶屋」として公開され、「初音ミクが立体的に見える」「本当に近寄られたようなドキドキ感がある」等、来場者・体験者からも高い評価を得ました(3)(図4)。さらにその後、システムの小型化に加えてフレームレス化を実現することで、より手軽にかつ高い没入体験の提供が可能になっています。

Another Me

■Another Meの「本人性・自律性・一体性」

私たちは、誰もが時間・空間またはハンディキャップなどの制約を超え、人生の機会を拡張できる社会の実現をめざしています。外見だけでなく行動や内面まで再現する「本人性」、メタバースでリアル世界の制約を超えて自律的に活動する「自律性」、またその活動の結果を本人自身の経験として共有する「一体性」、これらをすべて併せ持つのがAnother Meです(図5)。「わたし」と感じられるほどの本人性を実現するために哲学的な研究にも取り組んでおり、他者や社会とのつながりづくりにも役立てたいと考えています。想定されるユースケースは、専門知識を活用して本人の代わりにコンサルティングを行う、本人と協力して仕事を遂行するなどさまざまです。そうしたユースケースを踏まえ、私たちはAnother Meの要素技術の研究開発を行い、それら要素技術を活用した社会実装の取り組みも行っています。本誌では、そうした要素技術のうち、「身体モーション生成技術」「個性抽出技術」「個人性再現対話技術」の3つにフォーカスを当て、これらを活用した取り組みについて紹介したいと思います。

■自然な身体モーション表現を実現する「CONN」

NTTコミュニケーションズ、NTTコノキュー、東映株式会社の共創によって進めている仮想的な人格を持つデジタルヒューマン「CONN」(図6)においては、デジタルヒューマンの表情や全身動作(身体モーション)を、Another Meの身体モーションを生成する「身体モーション生成技術」と連携して検証を進めました。

「身体モーション生成技術」は、少量のデータから自然で人間らしい発話時の表情・全身の動きの生成を可能とする技術です(4)。身体モーションとそのときの発話音声や発話内容からモデルを生成することで、発話音声のみから身体モーションを自動で生成できるようになります。モデルの学習方法を工夫しており、発話の意味に沿った身体モーションの生成や意味的なまとまりを反映した身体モーションの滑らかさの向上、ならびに、定常的に出現する身体モーションだけでなく、特定の文脈で現れる身体モーションも含めて生成することが可能です。

デジタルヒューマン「CONN」においては、モデルとなる人物の身体モーションとそのときの発話を収録、モデル化し、「CONN」の発話に合わせてモーションを生成することで、「CONN」の人間らしい自然な身体モーション表現を実現しています。

■メタコミュニケーションサービス「MetaMe®」での個人性抽出・再現の実現

誰もが自分の分身であるAnother Meを持つことができるようになることをめざし、「個人性抽出技術」と「個人性再現対話技術」をNTTドコモが開発したメタコミュニケーションサービス「MetaMe®(メタミー)」に試験実装しています*(5)。

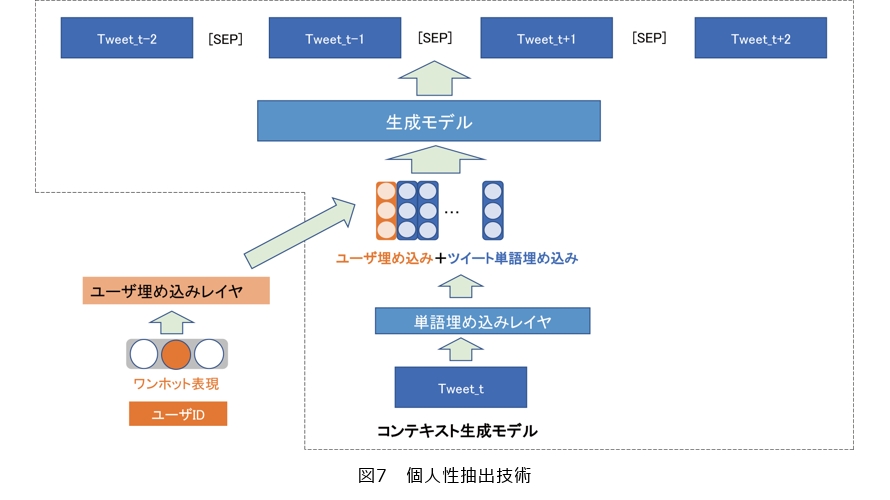

「個人性抽出技術」は個人の行動ログから、行動に影響を与える性格、価値観などの情報を埋め込んだ個人ごとのベクトルを学習する技術です(6)(図7)。これにより、本人の価値観にあった行動をAnother Meが再現できるようになります。例えば、価値観の類似度を比較して、価値観の近い人を見つけたり、多様な価値観を持つグループを作成したりすることができます。

「個人性再現対話技術」は少量のデータからその人らしい対話を再現する技術です。本技術は、年齢や性別などのユーザプロファイルに応じた対話内容を再現するペルソナ対話技術と、少量の対話データから個人の特徴(口調、言い回しなど)を学習するアダプタ技術を組み合わせることで、少量の学習データで個人の対話内容の再現を可能にしました(図8)。

これらの技術を用いて、自分の分身NPC(Non-Player Character)のプロトタイプを開発しています。分身NPCが自分の代わりに他のユーザと事前にコミュニケーションを取ることで、実際にユーザどうしがMetaMe®上で会ったときにコミュニケーションが活性化され、新しい出会いの創出につながるかなど、NTTドコモと一緒に実証実験を行っています。

* 「MetaMe」は、株式会社NTTドコモの登録商標です。

まとめ

前述のとおり、これまでの「メタバース」的サービスは仮想空間内に閉じたものであり、リアル世界とは別の体験を提供するものが大半でした。しかしMatthew Ball氏が提唱する「メタバースが備えるべき7つの特徴」の中でも触れられているとおり、今後はリアル世界とバーチャル世界がシームレスに連携・融合することで、「メタバース」におけるユーザ体験は2つの世界にまたがる体験になると考えられます。

私たちは、本稿で紹介した「Project Metaverse」の取り組みを通じて、リアル世界とバーチャル世界での体験を融合し、人と人、人と社会の「つながり」の質を高め、多様性を受容できる豊かな社会の実現をめざしていきます。今後の進展にご期待ください。

■参考文献

(1) https://www.jri.co.jp/MediaLibrary/file/column/opinion/pdf/13531.pdf

(2) https://group.ntt/jp/newsrelease/2022/11/15/221115b.html

(3) https://group.ntt/jp/newsrelease/2023/04/29/230429a.html

(4) C. Ahuja, D. W. Lee, R. Ishii, and L. P. Morency: “No Gestures Left Behind: Learning Relationships between Spoken Language and Freeform Gestures,” EMNLP: Findings, pp. 1884-1895, Nov.2020.

(5) https://group.ntt/jp/newsrelease/2024/01/17/240117a.html

(6) A.Otsuka,K.Hama, N.Nomoto, R.Ishii, A.Fukayama,and T.Nakamura:“Learning User Embeddings with Generating Context of Posted Social Network Service Texts,”Social Computing and Social Media,pp. 106–115,2023.

https://doi.org/10.1007/978-3-031-35915-6_9

(上段左から)阿部 直人/千明 裕/小合 健太/望月 崇由

(中段左から)石井 陽子/永徳 真一郎/Lidwina Andarini

(下段左から)鈴木 克洋/野本 済央/深山 篤

人間研では、リアルとバーチャルの融合を推進することで、人々の体験を拡張し、人と人、人と社会の「つながり」の質を高め、多様性を受容できる豊かな社会の実現をめざしていきます。今後の進展にご期待ください。